Сегодняшние студенты «с рождения» используют различные вычислительные устройства, а в Интернете по большинству теоретических и практических учебных дисциплин часто могут получить более полную и актуальную информацию, чем на лекциях. При этом материал в Сети часто подается и более эффектно, чем в аудиториях. Все это вызывает целый ряд вопросов. Интересно ли студентам на занятиях? Успевают ли они за преподавателем? Доступно ли излагается материал? Насколько студенты вовлечены в учебный процесс? Еще недавно контролировать уровень вовлеченности студентов было практически невозможно — только в московских учебных корпусах Финансового университета при Правительстве РФ занятия идут каждый день в более чем 500 аудиториях.

Тематика измерения и анализа вовлеченности студентов в учебный процесс активно разрабатывается еще с 1980-х годов — прежде всего, в связи с исследованием возможности снижения количества отчисляемых студентов (опросы показывают, что от 25 до 60% учащихся постоянно скучают на занятиях и отвлекаются от учебного процесса). Проблема мониторинга вовлеченности студентов сегодня актуальна как для традиционного аудиторного учебного процесса, так и для массовых открытых онлайн-курсов, образовательных игр, симуляторов и тренажеров, интеллектуальных обучающих систем и пр.

Наиболее распространены следующие методы измерения студенческой вовлеченности: самооценка вовлеченности самими студентами; внешнее наблюдение с использованием контрольных карт и последующим рейтингованием; автоматическое измерение уровня вовлеченности с применением технических средств. В частности, в российских исследованиях пока доминирует метод самооценок. Вместе с тем информационные системы для автоматической оценки вовлеченности используются уже достаточно давно. Значительная часть из них основана на анализе скорости и точности выполнения студентами контрольных заданий. Например, индикаторами слабой вовлеченности могут быть случайные ответы на легкие вопросы или очень короткое время выполнения заданий.

Есть также класс популярных методик автоматической оценки уровня вовлеченности, основанных на обработке данных с различных электро- и нейрофизиологических датчиков, однако ясно, что масштабное применение таких методик невозможно.

Еще один класс методик основан на использовании компьютерного зрения [1–6] — анализируя положение и наклон головы, направление взгляда, положение тела, жесты и т. п., вполне можно оценить вовлеченность студента в учебный процесс. Преимущество таких систем — их неинвазивность: сам процесс происходит почти незаметно для студентов, без отвлечения их внимания.

Система оценки вовлеченности на основании анализа видеоизображения строится на принципах машинного обучения. При этом измеряется предполагаемая вовлеченность — уровень вовлеченности студентов, оцениваемый внешними наблюдателями. Вначале некоторое количество фотографий лиц студентов в аудиториях предъявляется для классификации экспертам, которые выделяют вовлеченных в образовательный процесс студентов и отвлекающихся, а затем происходит обучение модели. После этого обученная модель классификации позволяет определять степень вовлеченности студентов уже на новых для модели и экспертов видеоизображениях.

Сервис распознавания вовлеченности развернут в облаке Microsoft Azure. Идентификация пользователей происходит с помощью сервиса каталогов Azure Active Directory, синхронизированных с локальными университетскими сервисами каталогов. Для идентификации студентов берутся фотографии из кампусной базы данных, а идентификация учебных дисциплин и преподавателей производится на основании информации из локальной базы данных «Расписание».

Сейчас система проходит пилотную эксплуатацию в двух учебных корпусах университета, к ней подключены около 60 видеокамер в аудиториях.

В отличие от известных систем, в которых вовлеченность измеряется на основании данных с видеокамер, размещенных на компьютерах и способных измерять уровень вовлеченности лишь отдельных студентов, в данной системе ведется мониторинг вовлеченности учащихся в масштабах всей образовательной организации.

Архитектура

На рис. 1 приведена архитектура облачного решения. Видеопоток поступает с поворотных видеокамер, размещенных под потолком аудиторий и подключенных к концентратору Microsoft Azure IoT Hub. Для управления камерами используются данные из локальной информационной системы «Расписание»: время начала и окончания занятия, номер аудитории, набор идентификаторов учебных групп (на семинарах — одна группа, на лекции — несколько), идентификаторы учебной дисциплины и преподавателя. Видеопотоки перед отправкой в хаб подвергаются локальной обработке — из них с заданной периодичностью захватываются отдельные кадры.

.jpg) |

| Рис. 1. Архитектура сервиса мониторинга вовлеченности |

Из IoT Hub изображение лица студента отправляется на вход Azure Cognitive Services для распознавания лиц и эмоций. Сервисы распознавания эмоций, используя кампусную базу фотографий учащихся, возвращают для каждого лица следующие признаки: возраст и пол; идентификатор студента; наличие помады, очков, усов, бакенбардов, бороды; наклон и поворот головы; идентификатор эмоций (счастье, печаль, удивление, гнев, страх, презрение, отвращение, нейтральность), а также специальные точки, определяемые на лицах (facial landmarks). Все эти признаки вместе с метаданными съемки (время съемки, тип учебного занятия и дисциплины, идентификатор преподавателя) заносятся в базу данных Azure SQL Database, а собственно изображения помещаются в хранилище Azure BLOB Storage.

Новые записи, появившиеся в таблице результатов распознавания лиц и эмоций, подаются на вход сервиса машинного обучения Azure Machine Learning Studio, который возвращает для каждого лица вероятность его отнесения к классу вовлеченных с заполнением соответствующего поля в таблице базы данных результатов распознавания лиц и эмоций. Кроме того, в эту таблицу заносятся показания датчиков температуры и параметры качества воздуха в конкретной аудитории.

Обработка событий в режиме реального времени осуществляется службой Azure Stream Analytics.

Служба PowerBI с заданной периодичностью в виде специальных отчетов выводит сводные таблицы, в которые заносятся результаты распознавания лиц и эмоций. Эти таблицы затем интегрируются в интерактивные панели на университетском портале.

Разметка изображений

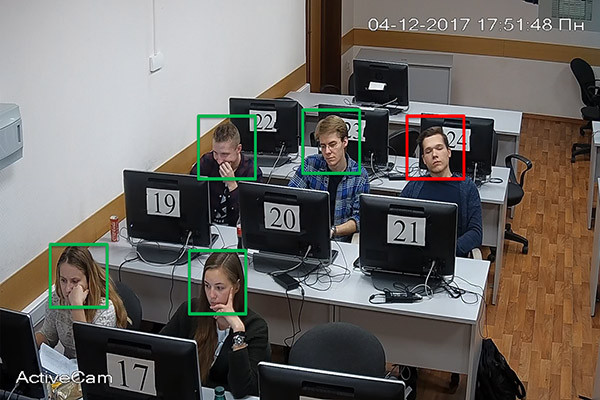

Для разметки изображений, по которым эксперты для каждого лица указывают степень вовлеченности студента в учебный процесс (рис. 2), разработано специальное приложение, опубликованное в облаке Azure.

.jpg) |

| Рис. 2. Визуализация результатов разметки вовлеченности |

В качестве экспертов выступают преподаватели, каждому из которых требуется оценить вовлеченность для определенного количества распознанных лиц. При этом основная часть лиц автоматически выбирается из изображений, полученных с видеокамер во время занятий, которые вел именно данный преподаватель (доля таких лиц является настраиваемым параметром, его значение рекомендуется устанавливать на уровне 90–95%), а оставшаяся часть лиц берется с кадров, сделанных во время занятий, проведенных другими преподавателями. Это необходимо для обеспечения адекватности оценок: если у какого-либо преподавателя оценки, сделанные им самим, не совпадают с оценками вовлеченности тех же студентов, сделанными другими преподавателями, это может стать причиной признания оценок неадекватными. У эксперта есть возможность не оценивать вовлеченность в случаях, когда это невозможно или не нужно (например, когда эксперту представляется снимок, сделанный на перемене, либо если лица на изображении не видно).

При создании веб-сервиса, определяющего вероятность отнесения студента к классу вовлеченных, строились модели логистической регрессии, деревьев и лесов решений, но наилучшие результаты классификации были получены с помощью модели усиленных деревьев решений ADABOOST Two-Class Boosted Decision Tree, для которой были получены следующие метрики качества: доля правильных ответов (Accuracy) оказалась равна 84,8%, точность (Presision) — 0,825, полнота (Recall) — 81,5%, F-мера (F1 Score) — 82,0%, площадь под ROC-кривой (AUC) — 91,2%. Такие результаты свидетельствуют о правомерности использования модели машинного обучения для распознавания уровня вовлеченности.

Среди факторов, оказывающих наибольшее влияние на степень вовлеченности, выделены (в порядке убывания важности): наклон головы; распознанный возраст; поворот головы; степень печали; уровень удивления; а также расположение некоторых точек на лице (facial landmarks).

Интерактивная панель системы размещена на странице, в меню которой можно выбрать период детализации отчетности: обзорная по семестрам или детальная по месяцам, дням, отдельным занятиям. Вовлеченность на любом уровне иерархии отображается в виде дискретной цветовой шкалы для выбранного периода.

Изначально главная страница отображает верхний уровень — факультеты, информация о которых доступна пользователю (сотрудникам ректората доступна информация о всех факультетах; сотрудникам деканата — о всех направлениях подготовки и уровнях образования, реализуемых на данном факультете; преподавателям и студентам — только об их занятиях).

В режиме детализации месяца дерево уровней выполнено в виде классического проводника; напротив каждого уровня (факультет, направление подготовки, уровень образования, курс, группа, студент, преподаватель) выводится информация о вовлеченности для выбранного уровня с усредненными значениями, отображаемыми цветом. На рис. 3 представлен фрагмент интерактивной панели визуализации.

.jpg) |

| Рис. 3. Фрагмент интерактивной панели визуализации |

***

Разработанный облачный сервис мониторинга вовлеченности студентов на основании анализа видеопотоков с камер, размещенных в аудиториях, и агрегации данных на интерактивных панелях визуализации позволяет администрации учебного заведения оперативно отслеживать динамику изменения вовлеченности групп студентов в ходе семестра, сравнивать изменения этого параметра во времени, по факультетам, курсам, группам и т. д. и при необходимости принимать решение по коррекции ситуации. Система функционирует как облачный сервис, который может быть использован для мониторинга вовлеченности сколь угодно больших групп студентов в масштабах любых учебных заведений. Результаты пилотного проекта демонстрируют достаточную степень его адекватности при использовании как администрацией образовательных организаций, так и преподавателями.

Литература

- Kapoor A., Picard R. Multimodal affect recognition in learning environments // Proceedings of the 13th Annual ACM International Conference on Multimedia (MULTIMEDIA 2005). — NY, USA: ACM, 2005. — P. 677–682.

- McDaniel B., D' Mello S., King B., Chipman P., Tapp K., Graesser A. Facial features for affective state detection in learning environments // Proceedings of the 29th Annual Conference of the Cognitive Science Society. Austin, USA: Cognitive Science Society, 2007. — P. 467–472.

- D' Mello S., Craig S., Graesser A. Multimethod assessment of affective experience and expression during deep learning // International Journal of Learning Technology. — 2009. — Vol. 4. — № 3. — P. 165–187.

- D' Mello S., Graesser A. Multimodal semi-automated affect detection from conversational cues, gross body language, and facial features // User Modeling and User-Adapted Interaction. — 2010. — Vol. 20. — № 2. — P. 147–187.

- Grafsgaard J., Fulton R., Boyer K., Wiebe E., Lester J. Multimodal analysis of the implicit affective channel in computer-mediated textual communication // Proceedings of the 14th ACM international conference on Multimodal interaction (ICMI 2012). — NY, USA: ACM, 2012. — P. 145–152.

- Whitehill J., Serpell Z., Lin Yi-Ch., Foster A., Movellan J.R. The faces of engagement: Automatic recognition of student engagement from facial expressions // IEEE Transactions on Affective Computing. — 2014. — Vol. 5. — № 1. — P. 86–98.

Владимир Соловьев (vsoloviev@fa.ru) — профессор, руководитель департамента анализа данных, принятия решений и финансовых технологий, Дарья Куклина (daria.kuklina@outlook.com), Артем Славгородский (a.a.slavgorodskiy@gmail.com) — студенты магистратуры, факультет прикладной математики и информационных технологий, Финансовый университет при Правительстве РФ; Илья Пухов (i.pukhov@zerobit.ru) — специалист по машинному обучению, Михаил Титко (m.titko@zerobit.ru) — архитектор информационных систем, компания «Зеробит» (Москва).